QoS : qualité de service réseau

La QoS, longtemps réservée aux ingénieurs réseau, est devenue un enjeu stratégique pour les entreprises qui dépendent de la téléphonie IP et des communications unifiées.

La QoS, ou qualité de service réseau, est devenue en quelques années un enjeu de gouvernance d’entreprise à part entière. Longtemps cantonnée aux discussions entre ingénieurs, quelque part entre deux lignes de configuration Cisco et un tableau de métriques SNMP, elle a basculé dans le champ stratégique le jour où les visioconférences sont devenues le premier canal de décision, où la téléphonie d’entreprise a migré sur IP, et où les applications métier ont rejoint le cloud.

Le taux d’adoption des politiques de QoS en entreprise est passé de 63 % en 2016 à 86 % en 2022, et la courbe ne fait que se confirmer depuis. La raison est simple. Quand la voix, la vidéo et la data partagent les mêmes tuyaux, un réseau qui ne priorise rien devient un réseau où l’appel stratégique du PDG décroche au moment où une sauvegarde mal planifiée sature le lien. C’est ce scénario que la QoS évite, à condition d’être correctement pensée, déployée et maintenue.

QoS : qu’est-ce que la qualité de service réseau ?

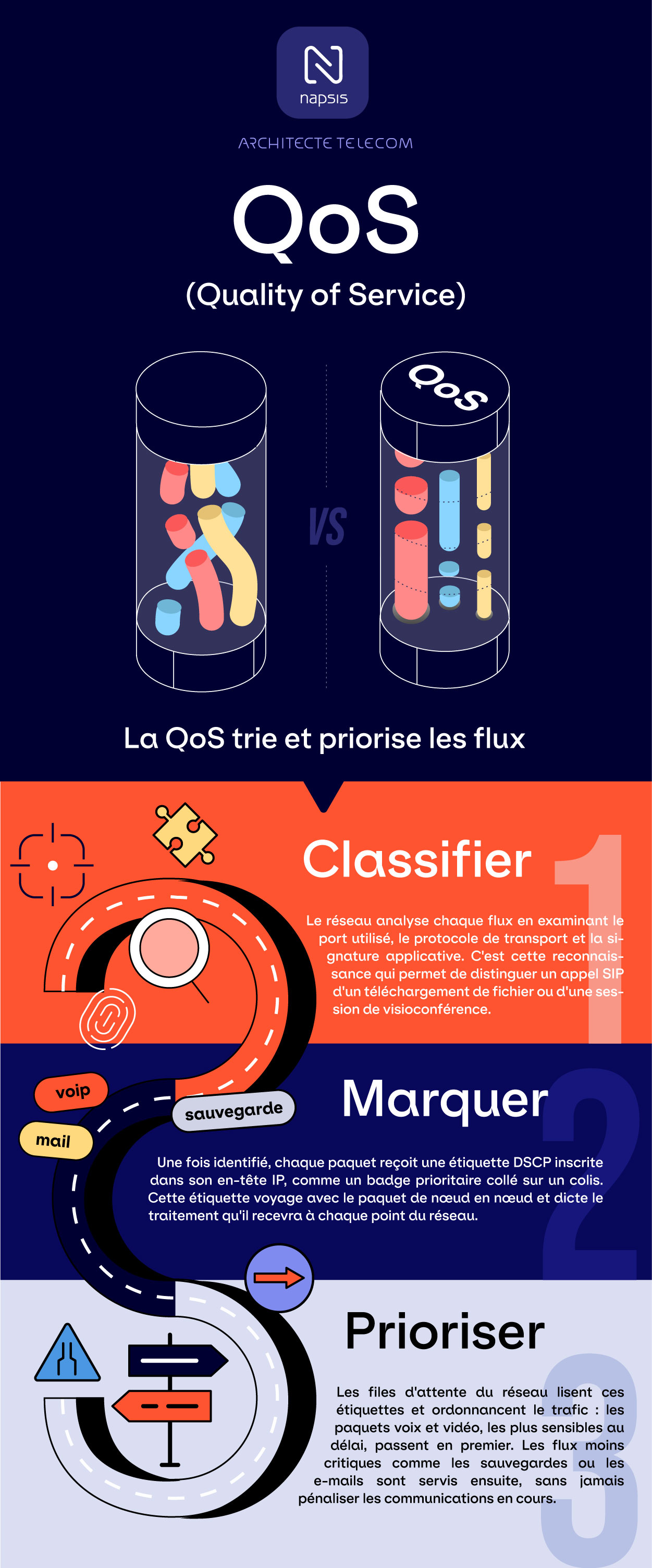

La QoS, acronyme de Quality of Service (qualité de service en français), désigne l’ensemble des mécanismes qui permettent à un réseau de prioriser certains flux sur d’autres. Concrètement, la QoS garantit que les communications sensibles comme la téléphonie IP, la visioconférence ou les applications métier critiques reçoivent un traitement prioritaire par rapport au trafic moins urgent, qu’il s’agisse de sauvegardes, de transferts de fichiers ou de mises à jour logicielles.

Définie pour la première fois par l’ITU en 1994, la QoS repose sur quatre indicateurs techniques mesurables. La latence, qui est le délai de transmission d’un paquet entre deux points. Le jitter, qui mesure la variation de ce délai dans le temps. Le taux de perte de paquets, qui traduit la fiabilité de l’acheminement. Et la bande passante disponible, qui détermine la capacité maximale du lien. Pour la téléphonie IP, les seuils critiques sont bien connus des intégrateurs. Au-delà de 150 ms de latence, l’écho devient audible. Au-delà de 30 ms de jitter, la voix se hache. Au-delà de 1 % de perte, les mots disparaissent. Une politique de QoS efficace maintient ces quatre indicateurs sous les seuils sur les flux qui en ont besoin, même quand le reste du réseau tire la langue.

Comment fonctionne la QoS sur un réseau d’entreprise

Pour comprendre ce que la QoS fait concrètement, il faut descendre au niveau du paquet. À tout instant, un réseau d’entreprise transporte des flux de nature très différente. Un appel SIP vers un client à Singapour voisine avec une réplication de base de données vers le site de PRA, pendant qu’un commercial consulte le CRM depuis un hôtel à Francfort et que trente postes téléchargent simultanément une mise à jour Windows. Sans arbitrage, tous ces paquets sont traités à égalité. La QoS est précisément le mécanisme qui rétablit la hiérarchie, en quatre étapes qui s’enchaînent.

Identifier et étiqueter : la classification et le marquage DSCP

Tout commence par la reconnaissance du trafic. L’équipement réseau, typiquement un routeur ou un switch de niveau 3, analyse chaque flux en examinant plusieurs paramètres. Le port utilisé, le protocole de transport (TCP, UDP, RTP), l’adresse source, la destination, ou des signatures applicatives plus fines qui permettent de distinguer un appel Microsoft Teams d’un téléchargement OneDrive alors que les deux transitent sur les mêmes ports. Cette phase de classification est le socle de toute politique de QoS réseau, car sans identification fiable aucune priorisation n’est possible.

Une fois reconnu, chaque paquet reçoit une étiquette de priorité inscrite dans son en-tête IP. On parle de marquage DSCP (Differentiated Services Code Point), un champ de 6 bits qui code la classe de service. La voix utilise en général la valeur EF (Expedited Forwarding, DSCP 46), la vidéo interactive AF41 (DSCP 34), les flux métier critiques AF31, et ainsi de suite selon la matrice définie par l’entreprise. Ce marquage voyage avec le paquet de bout en bout et dicte son traitement à chaque nœud du réseau. C’est l’équivalent d’un badge “prioritaire” collé sur un colis, que chaque manutentionnaire lit avant de décider dans quelle pile le poser.

Trier et ordonnancer : les files d’attente de la QoS

Une fois les paquets marqués, les mécanismes de file d’attente entrent en jeu. Les algorithmes de queuing comme LLQ (Low Latency Queuing) ou WFQ (Weighted Fair Queuing) organisent l’ordre de traitement selon la classe de service. Concrètement, le LLQ crée une file prioritaire stricte où les paquets marqués EF sont toujours traités avant les autres, tandis que les files non prioritaires se partagent la bande passante restante selon une pondération.

En téléphonie IP, cette étape est déterminante. Un appel VoIP en codec G.711 génère environ 80 kbps par appel et consomme très peu de bande passante, mais exige un traitement quasi instantané. Si un paquet voix patiente derrière un paquet de sauvegarde de 1500 octets dans une file FIFO classique, le jitter explose et la conversation se dégrade. Le LLQ sur les flux voix marqués EF est la règle d’or de toute politique de QoS en téléphonie d’entreprise, et c’est ce qui permet de maintenir un MOS (Mean Opinion Score) supérieur à 4 sur un réseau chargé.

Réguler et protéger : traffic shaping et gestion de congestion

Parallèlement, des techniques de traffic shaping et de policing régulent le débit de chaque classe de trafic. Le shaping lisse les pics d’envoi en stockant temporairement les paquets en excès, pour éviter qu’une réplication SQL de 500 Go ne monopolise un lien WAN au détriment d’un trunk SIP. Le policing, plus agressif, applique simplement une limite : tout paquet au-dessus du débit autorisé est soit rétrogradé dans une classe inférieure, soit jeté.

La dernière couche est la gestion active de la congestion. Des mécanismes comme WRED (Weighted Random Early Detection) commencent à écarter sélectivement les paquets de basse priorité avant même que les files ne débordent. L’idée est contre-intuitive mais efficace. Plutôt que de laisser toutes les files se remplir jusqu’à l’effondrement (le phénomène de “tail drop” qui pénalise aveuglément tout le trafic), WRED sacrifie à l’avance quelques paquets non critiques pour préserver les flux sensibles. C’est la différence entre un péage qui bloque tout le monde quand il sature et un système qui ferme les voies d’accès secondaires pour garder la voie prioritaire fluide.

La plupart des politiques de QoS matures en environnement entreprise définissent entre 8 et 12 classes de trafic distinctes, chacune avec ses propres seuils. Ce chiffre peut surprendre, mais il reflète la diversité des usages qui coexistent aujourd’hui sur un même réseau, entre la téléphonie temps réel, la vidéo, les applications métier transactionnelles, le SaaS, les sauvegardes et tout le reste.

QoS, MPLS et SD-WAN : quelle architecture pour la qualité de service réseau ?

Les principes de la QoS n’ont pas fondamentalement changé depuis l’ITU, mais le terrain sur lequel ils s’appliquent s’est transformé. L’arrivée du SD-WAN dans les discussions d’architecture WAN a relancé un débat que beaucoup croyaient tranché : faut-il conserver un réseau MPLS pour garantir la QoS, ou peut-on se reposer sur un SD-WAN qui s’appuie sur l’Internet public ? La réponse mérite d’être nuancée, surtout quand on parle de téléphonie d’entreprise.

Pourquoi le MPLS reste le standard de la QoS garantie

Pendant deux décennies, la QoS en environnement entreprise a reposé sur un socle éprouvé : le réseau MPLS (Multiprotocol Label Switching). Pour un décideur, le MPLS se résume à une promesse simple mais puissante. Un réseau privé opérateur, avec des garanties contractuelles (SLA) sur la bande passante, la latence, le jitter et le taux de perte, assorties de pénalités financières en cas de non-respect. Quand un opérateur s’engage sur un SLA MPLS, il met en jeu sa crédibilité commerciale et son chiffre d’affaires.

Cette garantie de bout en bout est ce qui fait du MPLS le socle le plus fiable pour la téléphonie d’entreprise et les communications unifiées. Un trunk SIP qui transite sur un VPN MPLS correctement dimensionné bénéficie d’une latence typique inférieure à 40 ms en national, d’un jitter sous les 5 ms et d’une perte de paquets sous les 0,1 %. Le MOS reste au-dessus de 4,2 même aux heures de pointe, ce qui correspond à une qualité vocale indiscernable d’une ligne RTC classique. C’est aussi ce qui permet à un opérateur télécom d’entreprise d’engager sa responsabilité sur la qualité des appels, et pas seulement sur la disponibilité du lien.

Le SD-WAN : flexibilité oui, garantie de QoS non

L’essor du SD-WAN a alimenté un discours commercial séduisant pour les directions financières. Remplacer le MPLS par de l’Internet public permettrait de diviser la facture télécom par deux ou trois, tout en gagnant en flexibilité. L’argument économique est réel. Mais il mérite d’être lu avec précision.

Le SD-WAN achemine le trafic sur l’Internet public, un environnement par nature imprévisible où la latence fluctue selon les pairs de peering traversés, où la bande passante n’est pas garantie, et où les chemins empruntés par les paquets changent dynamiquement en fonction des conditions observées. Pour compenser cette instabilité, le moteur de politiques du SD-WAN évalue en permanence les performances de chaque lien (MPLS, fibre Internet, 4G/5G de secours) et oriente les flux vers le chemin le moins dégradé à l’instant T. C’est une vraie intelligence réseau, mais elle repose sur un principe fondamentalement différent du MPLS : au lieu de garantir la qualité de service, le SD-WAN s’adapte à la dégradation.

Pour la téléphonie d’entreprise et les communications temps réel, cette nuance est capitale. Un appel VoIP qui bascule d’un lien dégradé vers un autre lien introduit mécaniquement une micro-coupure de l’ordre de 100 à 300 ms. Un SD-WAN bien configuré la rend imperceptible dans la plupart des cas, mais “la plupart du temps” n’est pas “toujours”, et pendant un incident majeur chez un fournisseur d’accès, aucune intelligence logicielle ne peut recréer une bande passante qui n’existe plus. C’est pour cette raison que nos architectures les plus robustes combinent les deux technologies. Le MPLS porte les flux critiques comme la voix, la vidéo interactive et les applications transactionnelles. Le SD-WAN prend en charge le trafic Internet, les SaaS et les sauvegardes. Opposer l’un à l’autre est un raccourci commercial qui coûte cher dès le premier incident.

De la QoS à la QoE : mesurer ce que l’utilisateur ressent

Ce débat sur le transport réseau a fait émerger un concept complémentaire : la Quality of Experience, ou QoE. Là où la QoS mesure des indicateurs techniques bruts (latence, jitter, taux de perte, débit), la QoE évalue la satisfaction réelle de l’utilisateur final d’un service de téléphonie ou de visioconférence. La différence se comprend immédiatement sur un appel vidéo. Les métriques QoS peuvent afficher des valeurs conformes au SLA pendant que l’interlocuteur perçoit une image saccadée, parce qu’un maillon de la chaîne (application mal optimisée, terminal vieillissant, codec mal négocié entre deux IPBX) dégrade l’expérience en bout de course.

En pratique, un bon intégrateur suit les deux dimensions. La QoS dans la supervision réseau, la QoE dans les tickets utilisateurs et les scores de satisfaction. Quand les deux divergent, c’est souvent le signe qu’un problème se cache ailleurs que dans le réseau : configuration IPBX, codec inadapté, terminal obsolète, latence applicative côté SaaS. Ne piloter que la QoS revient à surveiller la tuyauterie sans se soucier de ce qui sort du robinet.

Les conséquences d’une QoS absente ou mal configurée en entreprise

Les discussions sur la QoS restent abstraites tant qu’on n’a pas vécu la panne. Or l’absence de politique de QoS, ou une configuration figée depuis trop longtemps, ne se limite pas à quelques grésillements. Cela se chiffre en heures perdues, en contrats ratés et en crédibilité entamée auprès des clients et des collaborateurs.

La téléphonie IP dégradée, symptôme le plus visible

Le scénario que nous croisons le plus souvent en intervention. Une entreprise multisites a migré sa téléphonie sur IP il y a trois ou quatre ans. Les premiers mois se passent bien, puis les plaintes commencent à remonter. Les commerciaux signalent des appels hachés avec les clients. Le service support constate que certains appels se coupent après quelques minutes. La direction, elle, découvre le problème le jour où un échange stratégique avec un partenaire étranger devient inaudible.

L’audit technique révèle presque toujours le même enchaînement. Le réseau n’a pas été redimensionné depuis le déploiement initial. Une nouvelle application SaaS gourmande a été déployée sans que personne ne mette à jour les politiques de QoS. Une sauvegarde a été reprogrammée de 2h du matin à 14h sans concertation avec l’équipe télécom. Le trunk SIP, qui passait confortablement avant, se retrouve en concurrence avec des flux qui n’existaient pas à la mise en production. Les paquets voix marqués EF devraient passer en priorité, mais la politique de QoS n’ayant jamais été réajustée, ils finissent dans la file générique avec le reste. Comme la dégradation est progressive, elle passe souvent inaperçue des équipes IT jusqu’à ce qu’un dirigeant raccroche excédé.

La visioconférence, révélateur impitoyable du manque de QoS

La généralisation du travail hybride a rendu la visioconférence indispensable, et elle est devenue le révélateur le plus impitoyable des faiblesses réseau. Un Teams qui pixelise, un partage d’écran qui met trois secondes à se rafraîchir, un son qui coupe toutes les dix secondes, autant de symptômes que les utilisateurs identifient immédiatement, même sans compétence technique. La vidéo cumule les exigences. Gourmande en bande passante (2 à 4 Mbps par flux HD), sensible à la latence et totalement intolérante au jitter. Quand une politique de QoS ne différencie pas correctement les flux, le premier téléchargement venu impose sa dégradation à toutes les réunions en cours.

Le coût caché est considérable et rarement mesuré. Des réunions qui s’allongent de dix à vingt minutes parce que les participants doivent répéter leurs propos. Des prospects qui associent un appel de démonstration saccadé à une image d’amateurisme. Des décisions reportées parce que le partage d’écran n’arrive pas à afficher correctement un tableau de chiffres. Aucune de ces pertes n’apparaît dans un rapport de supervision réseau classique, ce qui explique pourquoi le sujet remonte rarement au comité de direction.

Les coûts cachés d’une politique de QoS négligée

Au-delà des incidents visibles, une QoS mal gérée génère des coûts que les directions financières repèrent rarement. Le premier est le surdimensionnement réflexe. Face aux plaintes utilisateurs, la réponse la plus courante consiste à demander plus de bande passante à l’opérateur. Or ajouter du débit sans politique de priorisation revient à élargir une autoroute sans voie réservée. Tous les flux profitent du nouvel espace, les indésirables compris, et le problème réapparaît au bout de quelques mois. Le cycle recommence, et chaque itération alourdit la facture opérateur sans régler le fond du problème.

Le deuxième coût invisible est celui du temps d’investigation. Sans visibilité sur le comportement des classes de trafic, chaque incident de qualité déclenche une chasse aux causes qui mobilise les équipes réseau pendant des heures, parfois des jours. Un trunk SIP qui sature à heures fixes, un jitter qui n’apparaît que sur un site distant, un codec qui négocie mal entre deux IPBX de générations différentes. Ces diagnostics sont longs et coûteux quand les outils de supervision ne corrèlent pas les indicateurs QoS aux flux applicatifs. Une politique de QoS bien gouvernée coûte moins cher, à long terme, qu’un réseau surdimensionné sans priorisation des flux critiques.

Monitoring et supervision de la QoS réseau

Configurer une politique de QoS est une chose. Vérifier qu’elle produit l’effet attendu dans le temps en est une autre, et c’est souvent là que les projets télécom trébuchent.

Pourquoi la configuration seule ne suffit plus

Un réseau d’entreprise évolue en permanence. De nouveaux sites se connectent, des applications apparaissent, les effectifs changent, les usages se déplacent. Une politique de QoS calibrée en janvier peut se retrouver à côté de la plaque en juin si personne ne vérifie l’adéquation entre les règles en place et le trafic réel. Nous voyons régulièrement des configurations qui datent du déploiement initial de l’IPBX, parfois cinq ou six ans en arrière, sur lesquelles plus personne ne sait précisément pourquoi telle classe est prioritaire et telle autre ne l’est pas.

Le monitoring réseau moderne corrige cette dérive. Les plateformes de supervision collectent en continu la télémétrie des équipements (routeurs, switches, firewalls, IPBX, SBC) via SNMP, NetFlow, sFlow ou des API plus récentes. Elles agrègent ensuite ces données dans des tableaux de bord qui permettent de visualiser en temps réel le comportement de chaque classe de trafic. Latence moyenne sur le trunk SIP principal, jitter par site distant, taux d’utilisation des files EF et AF41, top 10 des applications consommatrices. Ces indicateurs, corrélés dans le temps, révèlent des tendances qu’aucune intervention ponctuelle ne peut capter.

L’IA au service de la supervision QoS

L’intelligence artificielle s’invite précisément dans ce périmètre, non pour remplacer les équipes réseau mais pour leur donner une longueur d’avance. Les plateformes de supervision augmentées par l’IA analysent les flux en continu, apprennent les schémas de trafic habituels et détectent les anomalies avant qu’elles ne dégradent l’expérience utilisateur. Un exemple concret parmi ceux que nous croisons. Le système repère que chaque mercredi vers 10h, la perte de paquets grimpe de 15 % sur un lien précis. Il corrèle l’anomalie avec la plénière hebdomadaire en visio et avec une sauvegarde différentielle qui a été mal ordonnancée. Sans supervision intelligente, ce genre de pattern prend plusieurs semaines à être identifié manuellement, au prix de dizaines de tickets utilisateurs. Avec, il remonte en quelques jours avec une recommandation d’action.

Cisco intègre ce type de capacités dans DNA Center, où des intentions de haut niveau comme “priorité absolue au trafic voix” se traduisent en configurations granulaires déployées automatiquement sur les équipements. Juniper, avec son assistant Marvis alimenté par Mist AI, résout en autonomie certains problèmes de performance ou recommande des actions correctives. La supervision intelligente de la QoS n’est plus un luxe réservé aux grands comptes, elle devient un standard de la gestion réseau moderne, y compris pour des ETI et des PME structurées.

Du réactif au prédictif : un changement de posture

Ce passage d’une supervision réactive (“un utilisateur se plaint, on cherche le problème”) à une supervision prédictive (“le système détecte une dégradation imminente et agit avant l’impact”) change la posture des équipes IT. Les ingénieurs réseau passent moins de temps à éteindre des incendies et davantage à optimiser l’architecture, à dialoguer avec les directions métier, à préparer les évolutions à venir.

La transition suppose toutefois quelques prérequis qu’il faut regarder en face. Les réseaux hérités, équipés de matériel qui ne remonte pas de télémétrie fine ou qui ne parle qu’en CLI, résistent à l’automatisation et demandent un plan de modernisation. L’intégrité des données de télémétrie est un autre point de vigilance, parce qu’un modèle de machine learning nourri de données incomplètes ou biaisées produira des alertes erronées, et la confiance des équipes s’effondre rapidement si les faux positifs s’accumulent. Enfin, les collaborateurs réseau doivent accepter d’évoluer vers un rôle de supervision et d’arbitrage, plutôt que de configuration manuelle poste par poste. Ce glissement culturel est souvent le plus long à opérer, bien avant le déploiement technique.

Mettre en place une politique de QoS en entreprise : le rôle de l’intégrateur

La mise en place d’une politique de QoS efficace ne commence pas par la configuration d’un routeur. Elle commence par un audit, et c’est précisément ce qui sépare un projet qui tient dans la durée d’un projet qui décroche au premier pic de charge.

Un audit QoS avant toute chose

Quels flux transitent réellement sur votre réseau ? Quelles applications sont critiques pour votre métier, et à quel moment de la journée ? Où sont les goulets d’étranglement ? Sans cette photographie initiale, toute politique de priorisation repose sur des hypothèses plutôt que sur des faits, et les hypothèses vieillissent mal.

C’est précisément ce travail de diagnostic que l’intégrateur télécom apporte. Un audit de QoS sérieux cartographie les flux applicatifs sur une durée représentative (typiquement deux à quatre semaines pour capter les cycles hebdomadaires et un bout de cycle mensuel), mesure les indicateurs de performance sur chaque segment du réseau, identifie les pics et les creux, et confronte les résultats aux besoins métier exprimés par les directions concernées. Le livrable d’un bon audit de QoS n’est pas un rapport technique de 200 pages destiné à dormir dans un tiroir, mais un plan de priorisation des flux aligné sur les objectifs opérationnels de l’entreprise.

Concevoir, déployer et maintenir la QoS

L’audit posé, l’intégrateur conçoit l’architecture de QoS adaptée. Définition des classes de trafic (souvent entre 6 et 10 selon la maturité de l’organisation), matrice de marquage DSCP, paramétrage des files d’attente, politiques de shaping et de policing sur l’ensemble de la chaîne. Cette chaîne va du poste de travail et du switch d’accès jusqu’au trunk SIP et à l’interconnexion opérateur, en passant par le firewall, le SBC et le routeur WAN.

Cette mise en qualité s’appuie très souvent sur un VLAN VoIP dédié, qui permet de porter concrètement la QoS au niveau réseau en isolant les flux voix et en facilitant l’application de règles cohérentes dès le commutateur d’accès. La cohérence de bout en bout est essentielle. Une politique de QoS qui ne couvre qu’un segment du réseau laisse immanquablement des angles morts où les dégradations reviennent.

Le déploiement n’est que la moitié du chemin. Un réseau vit, évolue, se transforme. De nouvelles applications apparaissent, les effectifs changent, des sites ouvrent ou ferment. Une politique de QoS figée est une politique de QoS en fin de vie. C’est pourquoi, chez Napsis, le maintien en conditions opérationnelles (MCO) fait partie intégrante des contrats. Nos équipes surveillent l’adéquation entre les règles en place et le trafic réel, ajustent les paramètres quand l’usage change, et alertent le client avant que les utilisateurs ne subissent une dégradation. C’est cette continuité dans la durée qui explique pourquoi nos clients nous restent fidèles 9 ans et 7 mois en moyenne, là où la moyenne du marché tourne autour de 4 à 5 ans.

Faire le pont entre technique et direction

L’une des valeurs ajoutées les moins visibles mais les plus précieuses de l’intégrateur télécom est sa capacité à faire le pont entre le langage technique et le langage métier. Expliquer à un DSI pourquoi le trunk SIP sature à 11h tous les mardis, c’est un travail d’ingénieur qui passe par NetFlow, les files EF et les courbes de jitter. Expliquer à un directeur général que cette saturation coûte en moyenne quinze appels commerciaux manqués par semaine, et ce qu’il faut investir pour y remédier, c’est un travail de traduction que seul un intégrateur proche du terrain peut assumer. Les deux sont nécessaires, et aucun des deux seul ne résout le problème.

QoS et cybersécurité : la qualité de service au service de la résilience réseau

La question de la QoS croise celle de la cybersécurité plus étroitement qu’on ne le pense, et le lien est particulièrement fort sur la téléphonie et les communications unifiées.

Le DDoS, ennemi direct de la qualité de service

Le lien le plus visible passe par les attaques DDoS (Distributed Denial of Service). Leur principe est simple. Des milliers ou des millions de machines compromises, souvent des objets connectés mal sécurisés, envoient simultanément du trafic vers une cible pour la submerger et la rendre indisponible. L’ampleur de ces attaques a franchi des seuils inédits. En mai 2025, Cloudflare a mitigé un pic de 7,3 Tbps concentré en 45 secondes, soit environ 37,4 téraoctets déversés sur une seule cible. À ce niveau de volume, aucune bande passante commerciale ne tient.

Face à ce genre de pression, les mécanismes de QoS jouent un rôle de premier rempart. Ils garantissent que le trafic légitime critique, notamment les flux de téléphonie, continue de recevoir un traitement prioritaire pendant que le reste du réseau absorbe le choc. Microsoft décrit comment Azure combine traffic engineering et QoS pour bloquer les attaques par amplification directement au niveau de l’infrastructure de routage, avant même qu’elles n’atteignent les couches de mitigation dédiées. La QoS constitue la première ligne de résilience réseau, les systèmes anti-DDoS spécialisés forment la seconde. Cette défense en profondeur est devenue une bonne pratique dans les architectures à grande échelle, et c’est exactement la logique que nous appliquons chez nos clients exposés (e-commerce, services financiers, acteurs publics).

La QoS comme composante de la posture de sécurité

Au-delà du DDoS, la QoS participe à la posture de sécurité globale du réseau d’une manière souvent sous-estimée. Un réseau doté d’une classification fine du trafic dispose d’une visibilité précieuse pour les équipes cybersécurité. Un flux qui dépasse soudainement son profil habituel de bande passante, un pic de paquets malformés sur un port SIP, une latence anormale sur un segment de trunk opérateur sont autant de signaux d’alerte précoce. Les outils de supervision modernes augmentés par l’IA corrèlent ces anomalies en temps réel et peuvent déclencher des réponses automatisées, qu’il s’agisse d’isoler un segment suspect ou de réacheminer le trafic légitime.

Cette logique rejoint les principes du Zero Trust, une philosophie de sécurité qui consiste à ne jamais faire confiance par défaut à un flux réseau, même s’il provient de l’intérieur du périmètre. Segmenter le réseau en classes de trafic avec des droits et des priorités distincts, c’est déjà appliquer une forme de Zero Trust au niveau de la couche transport. Pour un intégrateur qui adresse à la fois le réseau, la téléphonie et la cybersécurité, cette convergence crée des synergies naturelles : l’audit de QoS nourrit l’analyse de risques, et les politiques de sécurité alimentent le design des classes de trafic.

QoS et 5G : ce que le network slicing va changer

L’arrivée de la 5G et de son mécanisme de network slicing (la capacité de découper un réseau physique en tranches virtuelles indépendantes, chacune avec ses propres garanties de performance) ouvre des perspectives que les opérateurs commencent à explorer. Pour la QoS, le slicing représente une évolution majeure. La priorisation du trafic s’étend jusqu’au réseau d’accès radio, là où elle s’arrêtait au cœur de réseau avec les technologies précédentes.

En pratique, le déploiement commercial du slicing reste limité à quelques grandes métropoles et à des pilotes sectoriels, notamment dans l’industrie et la santé. Pour la plupart des entreprises françaises, ce n’est pas encore un sujet d’architecture immédiat, et aucun opérateur ne propose aujourd’hui une tranche 5G avec des SLA comparables à un MPLS national. Mais c’est un sujet de veille stratégique, car le jour où les opérateurs proposeront des tranches 5G commercialisables avec des garanties de QoS contractuelles, l’équation du transport WAN sera profondément redistribuée. Les intégrateurs qui auront anticipé cette convergence, à la fois sur le SD-WAN, la 5G et les architectures hybrides, seront les mieux placés pour accompagner leurs clients dans cette transition.

Le fonctionnement de la QoS

FAQ

Quelle est la différence entre QoS et QoE ?

La QoS (Quality of Service) mesure les performances techniques du réseau à travers des indicateurs objectifs comme la latence, le jitter, le taux de perte de paquets et la bande passante disponible. La QoE (Quality of Experience) évalue la satisfaction réelle de l’utilisateur final. Un réseau peut afficher d’excellentes métriques QoS tout en offrant une expérience dégradée si l’application ou le terminal pose problème. Les deux approches sont complémentaires. La QoS fournit les outils de gestion du réseau, la QoE mesure si ces outils produisent le résultat attendu pour celui qui utilise le service.

Pourquoi la QoS est-elle si critique pour la téléphonie IP (VoIP) ?

La voix est le flux le plus exigeant en matière de temps réel. Un appel VoIP devient inintelligible dès que la latence dépasse 150 millisecondes, que le jitter excède 30 millisecondes ou que le taux de perte de paquets franchit 1 %. Contrairement à un e-mail ou un transfert de fichier, un paquet voix perdu ne peut pas être retransmis, la conversation est déjà passée. La QoS garantit que ces paquets vocaux, généralement marqués DSCP EF, reçoivent toujours un traitement prioritaire, même lorsque le réseau est saturé par d’autres flux.

Le SD-WAN peut-il remplacer le MPLS pour la QoS ?

Le SD-WAN apporte de la flexibilité et réduit les coûts en utilisant l’Internet public, mais il ne peut pas offrir les mêmes garanties contractuelles qu’un réseau MPLS. Le MPLS fournit une qualité de service garantie de bout en bout, adossée à des SLA contraignants pour l’opérateur. Le SD-WAN compense l’imprévisibilité de l’Internet par un routage intelligent, mais “s’adapter à la dégradation” n’est pas “garantir la qualité”. Pour les flux critiques comme la téléphonie ou les communications unifiées, les architectures les plus fiables utilisent le MPLS comme socle principal et le SD-WAN en complément.

Comment savoir si ma politique de QoS est encore adaptée ?

Le signe le plus courant d’une politique de QoS devenue obsolète est la multiplication des plaintes utilisateurs sur la qualité des appels ou de la visioconférence, alors que la bande passante théorique semble suffisante. Un audit de QoS permet de confronter les règles en place au trafic réel et d’identifier les écarts. Cette démarche est recommandée après tout changement significatif comme l’ajout de sites, la migration d’applications vers le cloud, le déploiement d’un nouvel IPBX ou une croissance rapide des effectifs.

La QoS protège-t-elle contre les cyberattaques ?

La QoS n’est pas un système de cybersécurité à proprement parler, mais elle y contribue. En garantissant un traitement prioritaire aux flux critiques, elle maintient la disponibilité des services essentiels (notamment la téléphonie) même lors d’une attaque DDoS. La classification fine du trafic fournit aussi une visibilité qui aide à détecter les anomalies. Les architectures les plus efficaces combinent politiques de QoS, segmentation réseau et systèmes de protection dédiés pour créer une défense en profondeur.

Pourquoi faire appel à un intégrateur pour la QoS en entreprise ?

Parce que la QoS touche l’ensemble de la chaîne réseau, du poste de travail jusqu’au trunk opérateur, en passant par le switch, le firewall et le SBC. Une politique efficace exige un audit préalable, une conception cohérente sur tous les segments, un déploiement maîtrisé et un suivi dans la durée. Un intégrateur spécialisé en télécom, réseau et cybersécurité apporte cette vision transversale et assure que les politiques de priorisation des flux restent alignées avec les évolutions métier de l’entreprise.